No ecossistema de IA, os modelos de difusão estão definindo a direção e o ritmo do avanço tecnológico. Eles estão revolucionando a maneira como abordamos tarefas complexas de IA generativa. Esses modelos são baseados na matemática dos princípios gaussianos, variância, equações diferenciais e sequências generativas. (Explicaremos o jargão técnico abaixo)

Produtos e soluções modernos centrados em IA desenvolvidos pela Nvidia, Google, Adobe e OpenAI colocaram os modelos de difusão no centro das atenções. DALL.E 2, Difusão estável e Midjourney são exemplos proeminentes de modelos de difusão que estão circulando na Internet recentemente. Os usuários fornecem um prompt de texto simples como entrada e esses modelos podem convertê-los em imagens realistas, como a mostrada abaixo.

Uma imagem gerada com o Midjourney v5 usando o prompt de entrada: vibrantes papoulas da Califórnia. Fonte: Midjourney

Vamos explorar os princípios fundamentais de funcionamento dos modelos de difusão e como eles estão mudando as direções e normas do mundo como vemos isso hoje.

O que são modelos de difusão?

De acordo com a publicação de pesquisa “ Denoising Diffusion Probabilistic Models,” os modelos de difusão são definidos como:

“Um modelo de difusão ou modelo de difusão probabilística é uma cadeia de Markov parametrizada treinada usando inferência variacional para produzir amostras correspondentes aos dados após um tempo finito ”

Simplificando, os modelos de difusão podem gerar dados semelhantes àqueles nos quais são treinados. Se o modelo treina com imagens de gatos, ele pode gerar imagens realistas semelhantes de gatos.

Agora vamos tentar quebrar a definição técnica mencionada acima. Os modelos de difusão se inspiram no princípio de funcionamento e na base matemática de um modelo probabilístico que pode analisar e prever o comportamento de um sistema que varia com o tempo, como prever o retorno do mercado de ações ou a propagação da pandemia.

A definição afirma que são cadeias de Markov parametrizadas treinadas com inferência variacional. Cadeias de Markov são modelos matemáticos que definem um sistema que alterna entre diferentes estados ao longo do tempo. O estado existente do sistema só pode determinar a probabilidade de transição para um estado específico. Em outras palavras, o estado atual de um sistema contém os possíveis estados que um sistema pode seguir ou adquirir a qualquer momento.

Treinar o modelo usando inferência variacional envolve cálculos complexos para distribuições de probabilidade. Tem como objetivo encontrar os parâmetros exatos da cadeia de Markov que correspondem aos dados observados (conhecidos ou reais) após um tempo específico. Esse processo minimiza o valor da função de perda do modelo, que é a diferença entre o estado previsto (desconhecido) e o estado observado (conhecido).

Uma vez treinado, o modelo pode gerar amostras correspondentes aos dados observados. Essas amostras representam possíveis trajetórias ou estados que o sistema poderia seguir ou adquirir ao longo do tempo, e cada trajetória tem uma probabilidade diferente de acontecer. Assim, o modelo pode prever o comportamento futuro do sistema gerando um intervalo de amostras e encontrando suas respectivas probabilidades (probabilidade de esses eventos acontecerem).

Como interpretar modelos de difusão em IA?

Os modelos de difusão são modelos generativos profundos que funcionam adicionando ruído (ruído Gaussiano) aos dados de treinamento disponíveis (também conhecido como processo de difusão direta) e, em seguida, invertendo o processo (conhecido como redução de ruído ou processo de difusão reversa) para recuperar os dados. O modelo aprende gradualmente a remover o ruído. Este processo de redução de ruído aprendido gera novas imagens de alta qualidade a partir de sementes aleatórias (imagens com ruído aleatório), conforme mostrado na ilustração abaixo.

Processo de difusão reversa: Uma imagem com ruído é eliminada para recuperar a imagem original (ou gerar suas variações) por meio de um modelo de difusão treinado. Fonte: Modelos probabilísticos de difusão sem ruído

3 categorias de modelos de difusão

Existem três estruturas matemáticas fundamentais que sustentam a ciência por trás dos modelos de difusão. Todos os três trabalham com os mesmos princípios de adicionar ruído e removê-lo para gerar novas amostras. Vamos discuti-los abaixo.

Um modelo de difusão adiciona e remove ruído de uma imagem. Fonte: Modelos de difusão na visão: uma pesquisa

1. Modelos Probabilísticos de Difusão Denoising (DDPMs)

Como explicado acima, DDPMs são modelos generativos usados principalmente para remover o ruído de dados visuais ou de áudio. Eles mostraram resultados impressionantes em várias tarefas de redução de ruído de imagem e áudio. Por exemplo, a indústria cinematográfica usa ferramentas modernas de processamento de imagem e vídeo para melhorar a qualidade da produção.

2. Modelos Gerativos Baseados em Pontuação Condicionados por Ruído (SGMs)

Os SGMs podem gerar novas amostras de uma determinada distribuição. Eles trabalham aprendendo uma função de pontuação de estimativa que pode estimar a densidade de log da distribuição de destino. A estimativa de densidade de log faz suposições para pontos de dados disponíveis que fazem parte de um conjunto de dados desconhecido (conjunto de teste). Essa função de pontuação pode gerar novos pontos de dados da distribuição.

Por exemplo, deep fakes são notórios por produzir vídeos e áudios falsos de personalidades famosas. Mas eles são atribuídos principalmente a Generative Adversarial Networks (GANs). No entanto, os SGMs mostraram recursos semelhantes – às vezes superam – na geração de rostos de celebridades de alta qualidade. Além disso, os SGMs podem ajudar a expandir os conjuntos de dados de saúde, que não estão prontamente disponíveis em grandes quantidades devido a regulamentos rígidos e padrões do setor.

3. Equações diferenciais estocásticas (SDEs)

SDEs descrevem mudanças em processos aleatórios em relação ao tempo. Eles são amplamente usados em física e mercados financeiros envolvendo fatores aleatórios que impactam significativamente os resultados do mercado.

Por exemplo, os preços das commodities são altamente dinâmicos e impactados por uma série de fatores aleatórios. SDEs calculam derivativos financeiros como contratos futuros (como contratos de petróleo bruto). Eles podem modelar as flutuações e calcular preços favoráveis com precisão para dar uma sensação de segurança.

Principais aplicações de modelos de difusão em IA

Vejamos algumas práticas amplamente adaptadas e usos de modelos de difusão em AI.

Geração de vídeo de alta qualidade

Criar vídeos de alta qualidade usando aprendizado profundo é um desafio, pois requer alta continuidade de quadros de vídeo. É aqui que os modelos de difusão são úteis, pois podem gerar um subconjunto de quadros de vídeo para preencher entre os quadros ausentes, resultando em vídeos suaves e de alta qualidade, sem latência.

Pesquisadores desenvolveram o Modelo de difusão flexível e técnicas de difusão de vídeo residual para atender a essa finalidade. Esses modelos também podem produzir vídeos realistas adicionando quadros gerados por IA entre os quadros reais.

Esses modelos podem simplesmente estender o FPS (quadros por segundo) de um vídeo com baixo FPS adicionando quadros fictícios depois de aprender o padrões de quadros disponíveis. Com quase nenhuma perda de quadro, essas estruturas podem ajudar ainda mais os modelos baseados em aprendizado profundo a gerar vídeos baseados em IA do zero que se parecem com fotos naturais de configurações de câmera de ponta.

Uma ampla variedade de vídeos de IA notáveis geradores está disponível em 2023 para tornar a produção e edição de conteúdo de vídeo rápida e direta.

Geração de texto para imagem

Modelos de texto para imagem usam prompts de entrada para gerar alta qualidade imagens. Por exemplo, dando entrada “maçã vermelha em um prato” e produzindo uma imagem fotorrealista de uma maçã em um prato. Difusão combinada e unCLIP são dois exemplos proeminentes de tais modelos que podem gerar imagens altamente relevantes e precisas com base na entrada do usuário.

Além disso, GLIDE by OpenAI é outra solução amplamente conhecida lançada em 2021 que produz imagens fotorrealistas usando a entrada do usuário. Posteriormente, a OpenAI lançou o DALL.E-2, seu modelo de geração de imagens mais avançado até agora.

Da mesma forma, o Google também desenvolveu um modelo de geração de imagens conhecido como Imagen, que usa um grande modelo de linguagem para desenvolver uma compreensão textual profunda do texto de entrada e, em seguida, gera imagens fotorrealistas.

Mencionamos outras ferramentas populares de geração de imagens, como Midjourney e difusão estável (DreamStudio) acima. Dê uma olhada em uma imagem gerada usando Stable Diffusion abaixo.

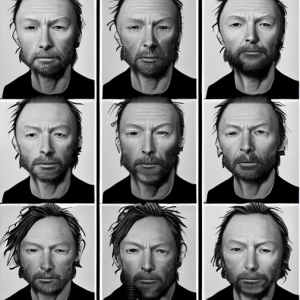

Uma imagem criada com Stable Diffusion 1.5 usando o seguinte prompt: “colagens, hiper-realistas, muitas variações, retrato do velho Thom yorke, variações faciais, cantor e compositor, ( lado ) perfil, várias idades, lente macro, espaço liminar, por lee bermejo, alphonse mucha e greg rutkowski, barba grisalha, rosto liso, maçãs do rosto”

Modelos de difusão em IA – O que esperar no futuro?

Modelos de difusão em IA – O que esperar no futuro?

h2>

h2>

Os modelos de difusão revelaram um potencial promissor como uma abordagem robusta para gerar amostras de alta qualidade a partir de conjuntos de dados complexos de imagem e vídeo. Ao melhorar a capacidade humana de usar e manipular dados, os modelos de difusão podem potencialmente revolucionar o mundo como o vemos hoje. Podemos esperar ver ainda mais aplicações de modelos de difusão se tornando parte integrante de nossas vidas diárias.

Dito isso, os modelos de difusão não são a única técnica de IA generativa. Os pesquisadores também usam Generative Adversarial Networks (GANs), Variational Autoencoders e modelos generativos profundos baseados em fluxo para gerar conteúdo de IA. Compreender as características fundamentais que diferenciam os modelos de difusão de outros modelos generativos pode ajudar a produzir soluções mais eficazes nos próximos dias.