A menos que você tenha estado em um retiro em algum local distante sem acesso à internet nos últimos meses, é provável que você esteja bem ciente de quanto hype e medo tem havido por aí ChatGPT, o chatbot de inteligência artificial (IA) desenvolvido pela OpenAI. Talvez você tenha visto artigos sobre acadêmicos e professores preocupados com o fato de vai tornar a trapaça mais fácil do que nunca. Do outro lado da moeda, você deve ter visto os artigos que evangelizam todos os aplicações potenciais.

Como alternativa, você pode ter se sentido atraído por alguns dos exemplos mais esotéricos de pessoas usando a ferramenta. Um usuário, por exemplo, conseguiu escrever um guia de instruções para remover sanduíches de manteiga de amendoim de um videocassete no style of the King James Bible. Outro pediu-lhe que escrevesse uma canção ao estilo de Nick Cave; o cantor era menos do que entusiasmado com os resultados.

Mas em meio a todo esse hype e discussão, não houve atenção suficiente para os riscos e recompensas que as ferramentas de IA como ChatGPT presente na arena de segurança cibernética.

Entendendo o ChatGPT

Para ter uma ideia mais clara de como são esses riscos e recompensas, é importante entender melhor o que é o ChatGPT e o que é capaz.

ChatGPT (agora em sua versão mais recente, ChatGPT-4, lançada em 14 de março de 2023) faz parte de uma família maior de ferramentas de IA desenvolvidas pela empresa norte-americana OpenAI. Embora seja oficialmente chamado de chatbot, isso não cobre totalmente sua versatilidade. Treinado usando supervisionado e reforço técnicas de aprendizado, ele pode fazer muito mais do que a maioria dos chatbots. Como parte de suas respostas, ele pode gerar conteúdo com base em todas as informações sobre as quais foi treinado. Essas informações incluem conhecimentos gerais, bem como linguagens de programação e código. Como resultado, ele pode, por exemplo, simule uma sala de bate-papo inteira; jogar jogos como tic-tac-toe; e simular um caixa eletrônico.

Mais importante, para empresas e outras grandes organizações, ele pode ajudar a melhorar o atendimento ao cliente por meio de mensagens mais personalizadas e precisas. Ele pode até escrever e depurar programas de computador. Alguns desses e outros recursos significam que ele pode ser um aliado da segurança cibernética e uma ameaça.

Educação, filtragem e reforço das defesas

On na frente positiva, há muito a ser dito sobre o ChatGPT. Uma das funções mais valiosas que ele pode desempenhar é também uma das mais simples: detectar phishing. As organizações podem criar o hábito de seus funcionários usarem o ChatGPT para determinar se algum conteúdo sobre o qual não têm certeza é phishing ou se foi gerado com intenção maliciosa.

Isso é importante porque, apesar de todos os avanços tecnológicos feitos nos últimos anos, os ataques de engenharia social, como phishing, continuam sendo uma das formas mais eficazes de cibercrime. Na verdade, a pesquisa mostra que, dos ataques cibernéticos identificados com sucesso no Reino Unido em 2022, 83 por cento envolveu alguma forma de phishing.

Claro, existem inúmeras outras maneiras que o ChatGPT pode ser usado para reforçar os esforços de segurança cibernética. Poderia, por exemplo, fornecer um certo grau de assistência a funcionários de segurança mais juniores, seja na comunicação de quaisquer problemas que possam ter ou ajudando-os a entender melhor o contexto do que devem trabalhar em um determinado momento. Também pode ajudar equipes com poucos recursos a selecionar as ameaças mais recentes e identificar vulnerabilidades internas.

Os bandidos também estão usando

Mas mesmo como segurança cibernética profissionais exploram maneiras de usar o ChatGPT a seu favor, os cibercriminosos também. Eles podem, por exemplo, fazer uso de sua capacidade de gerar código malicioso. Como alternativa, eles podem usá-lo para gerar conteúdo que parece ser gerado por humanos, potencialmente usado para induzir os usuários a clicar em links maliciosos, levando a consequências perigosas sem saber.

Alguns estão até usando o ChatGPT para imita de forma convincente assistentes de IA legítimos em sites corporativos, abrindo um novo caminho na frente de batalha da engenharia social. Lembre-se de que o sucesso dos cibercriminosos depende em grande parte de serem capazes de atingir o maior número possível de vulnerabilidades, com a maior frequência e rapidez possível. Ferramentas de IA como o ChatGPT permitem que eles façam isso agindo essencialmente como um assistente superalimentado que pode ajudar a criar todos os ativos necessários para campanhas maliciosas.

Use as ferramentas disponíveis

Deve ficar claro então que, se os cibercriminosos estão usando ChatGPT e outras ferramentas de IA para aprimorar seus ataques, sua equipe de segurança também deve usá-los para reforçar seus esforços de segurança cibernética. Felizmente, você não precisa fazer isso sozinho.

O provedor de segurança certo não se envolverá apenas em pesquisas constantes sobre como os cibercriminosos estão usando as tecnologias mais recentes para aprimorar seus ataques, mas também como essas tecnologias podem ser usado para melhorar a detecção, prevenção e defesa de ameaças. E com o dano que um ataque de segurança cibernética pode causar à sua infraestrutura crítica, é algo que eles também deveriam informar a você de forma proativa.

ChatGPT-4

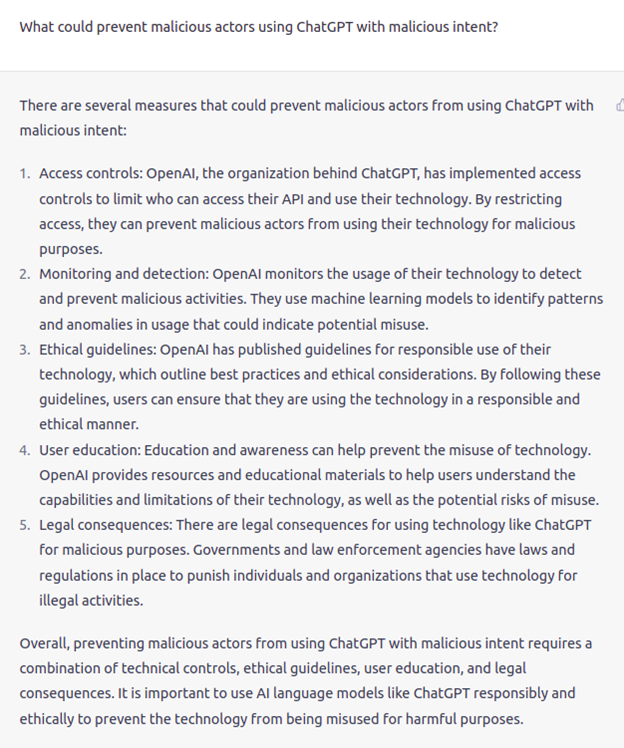

Com a versão mais recente do ChatGPT (ChatGPT-4), a OpenAI disponibilizou o mais recente e poderoso modelo de conversação, introduzindo também mais controles para evitar seu uso indevido. Perguntamos ao ChatGPT”O que poderia impedir que atores mal-intencionados usem o ChatGPT com intenção maliciosa”e esta foi a resposta:

Então, o ChatGPT foi em frente e enumerou todas as medidas que a OpenAI tomou para evitar seu uso indevido. OpenAI no blog de lançamento do ChatGPT-4 explicou como este modelo é supostamente mais seguro do que seus antecessores:”Passamos 6 meses fazendo O GPT-4 é mais seguro e mais alinhado. O GPT-4 tem 82% menos probabilidade de responder a solicitações de conteúdo proibido e 40% mais chances de produzir respostas factuais do que o GPT-3.5 em nossas avaliações internas”.

Então tudo indica que as medidas certas continuam sendo aprimoradas para evitar seu uso indevido, mas como todos sabemos os bandidos continuarão encontrando maneiras de superar essas limitações à medida que o modelo for mais amplamente utilizado e compreendido.

Crédito da imagem: [email protegido]/depositphotos.com

JP Perez-Etchegoyen é CTO da Onapsis.