ที่งาน Google Live ในปารีส บริษัทได้ประกาศแผนการที่จะทำให้การค้นหาใน Maps ง่ายขึ้นผ่านการรวม AI

อีกไม่นาน คุณจะสามารถใช้ Lens บน Android เพื่อค้นหารูปภาพใดๆ บนหน้าจอโดยไม่ต้องออกจากแอป ตัวอย่างเช่น คุณสามารถค้นหาจุดสังเกตในภาพที่เพื่อนส่งให้คุณในแชทได้โดยการกดปุ่มเปิด/ปิดหรือปุ่มโฮมบนโทรศัพท์ Android ซึ่งจะเรียก Google Assistant ของคุณ แล้วแตะ”หน้าจอค้นหา”Lens จะเข้าไปอยู่ในรูปภาพและระบุตัวตน ทำให้คุณสามารถคลิกเพื่อเรียนรู้เพิ่มเติมได้

Google กำลังนำ’การค้นหาหลายรายการ’ซึ่งรวมข้อความและรูปภาพไว้ในข้อความค้นหาเดียว มาสู่อุปกรณ์เคลื่อนที่ทั่วโลก ในทุกภาษาและทุกประเทศที่มี Lens ให้บริการ แต่ Google กำลังเพิ่มความสามารถในการค้นหาในท้องถิ่น

เพียงถ่ายรูปแล้วเพิ่ม”ใกล้ฉัน”เพื่อค้นหาสิ่งที่คุณต้องการ ไม่ว่าคุณจะต้องการสนับสนุนการซื้อกลับบ้านในพื้นที่ของคุณหรือเพียงแค่ต้องการ รีบหาอะไรทำ ขณะนี้มีให้บริการเป็นภาษาอังกฤษในสหรัฐอเมริกา และในอีกไม่กี่เดือนข้างหน้า เราจะขยายไปทั่วโลก

เคยคิดว่าห้างสรรพสินค้าทุกแห่งในสิงคโปร์เหมือนกันไหม ตอนนี้คุณสามารถค้นหาร้านที่ต้องการได้อย่างง่ายดายเมื่อ Live View ในอาคารมาถึงสิงคโปร์ในอีกไม่กี่เดือนข้างหน้า นำทางไปยังสนามบิน สถานีรถไฟ และศูนย์การค้าได้อย่างง่ายดาย และไม่หลงทางอีกต่อไป

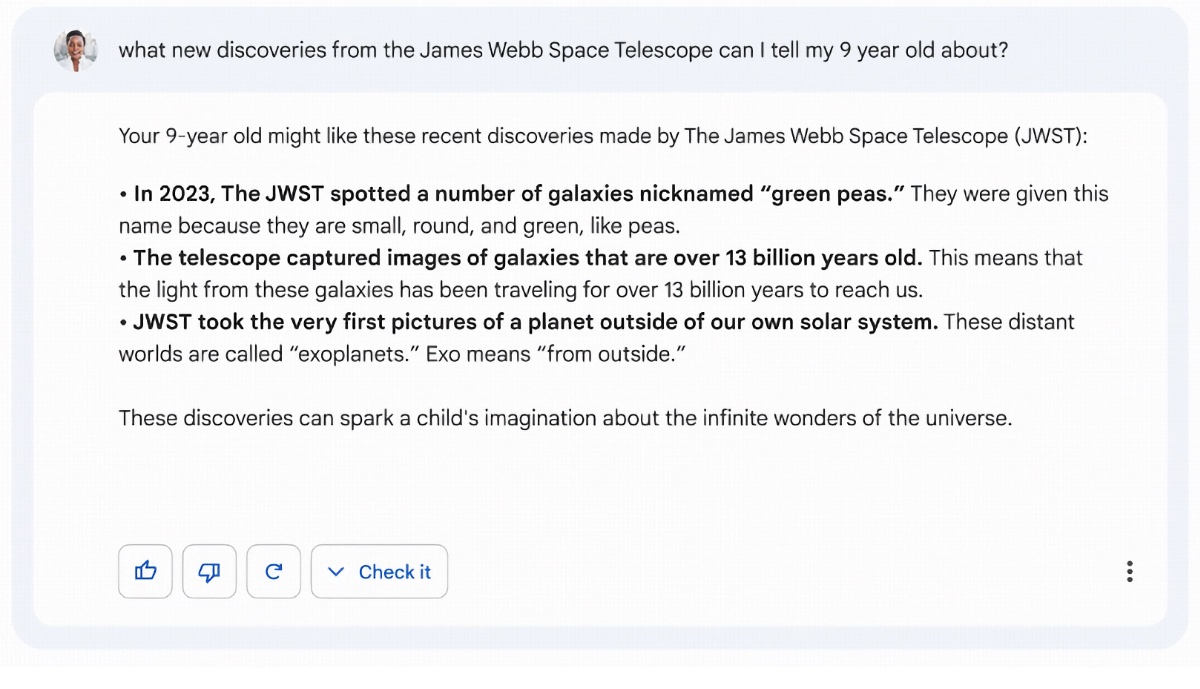

อ๊ะ…AI เข้าใจผิดแล้ว

แต่คุณอาจต้องการระงับการพึ่งพา AI ของ Google โดยสิ้นเชิง

Bard แชทบ็อตที่ขับเคลื่อนด้วย AI ของ Google ซึ่ง ขับเคลื่อนโดย LaMDA ผิดพลาดซึ่ง ตามรายงานข่าวออนไลน์ มูลค่าตลาดของบริษัทมีมูลค่า 1 แสนล้านดอลลาร์

ในบล็อกโพสต์ประกาศเปิดตัวกวี Sundar Pichai ซีอีโอของบริษัทแม่ Google Alphabet แสดงวิดีโออธิบายการค้นพบใหม่จากกล้องโทรทรรศน์อวกาศเจมส์เว็บบ์ของ NASA เป็นเวลา 9 ปี-เก่า. หนึ่งในคำตอบจากบาร์ดคือกล้องโทรทรรศน์ถ่ายภาพ”ภาพแรกของดาวเคราะห์นอกระบบสุริยะของเรา”

น่าเสียดายที่ภาพแรกของดาวเคราะห์นอกระบบถูกจับภาพโดยกล้องโทรทรรศน์ขนาดใหญ่มาก ซึ่งเป็นอาร์เรย์บนพื้นดินในชิลีในปี 2547 และยืนยันว่าเป็นดาวเคราะห์นอกระบบในปี 2548 ตามข้อมูลของ NASA ซึ่งนานก่อนที่ James Webb จะเปิดตัวในปี 2564

โพสต์ Twitter จาก Google พร้อม ข้อความค้นหาถูกเข้าชม 1.4 ล้านครั้ง

แหล่งข่าว: Reuters